Nog maar twaalf jaar geleden kwam de eerste smartphone op de markt, tegenwoordig kunnen we niet meer zonder. Maar wat zijn de gevolgen van die voortschrijdende technologie? Redacteur Bouke van Balen vroeg het aan twee wetenschappers die daar nu onderzoek naar doen. “De tijd tikt. We kunnen niet langer wachten.”

Kunstmatige intelligentie is de wereld in een rap tempo aan het veranderen. Toch ontwikkelt het maatschappelijk besef rondom kunstmatige intelligentie een stuk minder snel dan de ontwikkeling van de technologie zelf. Zo kwam vorig jaar voor iedereen een absolute schok: Facebook en Cambridge Analytica werden ervan verdacht kiezers op basis van hun persoonlijkheid te hebben gemanipuleerd om op Donald Trump of voor een brexit te stemmen.

Hoog tijd dus voor wetenschappelijk onderzoek naar de maatschappelijke implicaties van kunstmatige intelligentie, vonden Natali Helberger en Sonja Smets, allebei hoogleraar aan de Universiteit van Amsterdam. Helberger in informatierecht, Smets in logica en epistemologie. Zij zorgden samen met hun mede-initiatiefnemers Julia Noordegraaf en Claes de Vreese voor een nieuw onderzoekszwaartepunt binnen de UvA: Human(e) AI, ofwel menselijke kunstmatige intelligentie.

Menselijker

“AI, of artificial intelligence, is een bestaand onderzoeksgebied en maakt heel veel ontwikkeling door aan de exacte kant van de wetenschap,” legt Smets op haar werkkamer aan de Oude Turfmarkt uit. “Machines die leren zorgen ervoor dat we met veel data heel snel nieuwe dingen kunnen doen, zoals automatisch beslissingen nemen. Dit heeft implicaties voor de maatschappij. We zien dat er nood is aan reflectie binnen die maatschappij, door de veranderingen die het teweegbrengt.”

Deze nood komt onder andere voort uit een gebrek aan bewustzijn van de implicaties die kunstmatige intelligentie op de samenleving heeft. Zie daar: Human(e) AI. Door de ethische, juridische en maatschappelijke gevolgen van kunstmatige intelligentie in kaart te brengen kan deze menselijker worden, hopen de onderzoekers.

De vraag rijst wie de verantwoordelijkheid draagt voor de voorpagina van de krant. De https://redpers.nl/wp-content/uploads/2020/09/redperslogo-1.png of het algoritme?

De in kaart te brengen gevolgen zijn onderverdeeld in een aantal thema’s. Een van die thema’s is het ‘herorganiseren van processen en spelers‘. Helberger: “Er wordt meer AI ingezet in instituten en beslissingssystemen. Daardoor veranderen die beslissingsprocedures, zoals in de nieuwsmedia. Vroeger was het een redacteur die bepaalde wat er op de voorpagina zou komen, nu is dat een aanbevelingssysteem. Zo’n systeem wordt niet door de journalisten zelf ontwikkeld.” Daarmee is het niet meer de redacteur, maar de app-ontwikkelaar of misschien de app zelf die beslist wat er in de krant komt.

De vraag rijst wie de verantwoordelijkheid draagt voor de voorpagina van de krant. De https://redpers.nl/wp-content/uploads/2020/09/redperslogo-1.png of het algoritme? Wat als er plots iets radicaals op de voorpagina belandt? “Dan hebben we geen procedure om te bepalen wie de verantwoordelijkheid draagt. En dus moet er onderzoek naar gedaan worden,” stelt Helberger.

Filterbubbel

Wet- en regelgeving lopen vaak achter op technologische ontwikkelingen. In het geval van AI is dat problematisch, aangezien we ons in een beweging bevinden die vergelijkbaar is met de industriële revolutie. Helberger: “AI wordt vaak vergeleken met de industriële revolutie. Er is écht een significant effect op hoe wij werken, leren, boodschappen doen, daten of democratische beslissingen nemen. Daarom moeten wij hier onderzoek naar doen. AI functioneert nooit los van de maatschappij. Het is geïntegreerd in onze maatschappij.”

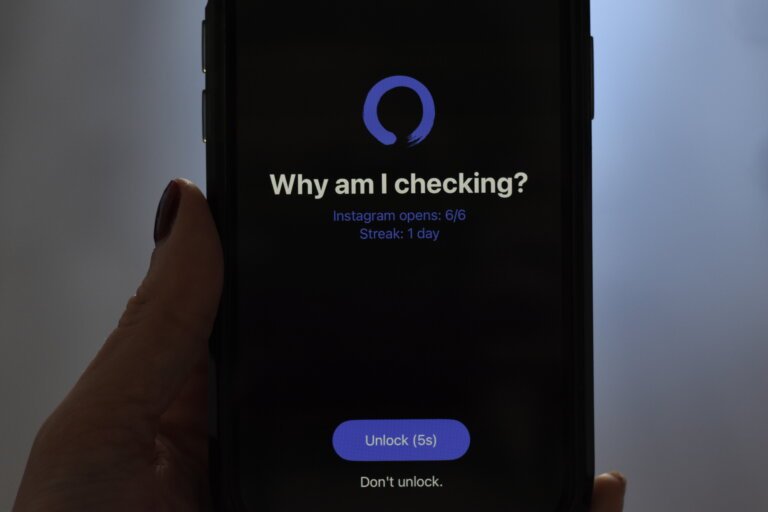

In die maatschappij staan onze normen en waarden centraal. Volgens Smets en Helberger vraagt de digitale revolutie ons ook om deze opnieuw te bekijken. Concepten krijgen een nieuwe betekenis in het licht van de ontwikkelingen die er gaande zijn. Zo staat ons idee van autonomie ter discussie dankzij de zogenaamde filterbubbels. Achter de aanbevelingssystemen die je vertellen naar welk museum je moet gaan, zit een bepaald filteringsmechanisme. Je krijgt alleen opties te zien waarvan het mechanisme denkt dat ze bij jou passen. Dit tast in zekere zin je autonomie aan, aangezien de keuzevrijheid niet meer helemaal bij jezelf ligt.

Voor de keuze van een museum hoeft dat niet erg te zijn, maar de filterbubbel kan volgens Smets wel degelijk een nadelig effect hebben: “We zien bijvoorbeeld in het vaccinatiedebat online dat er polarisatie ontstaat doordat mensen geneigd zijn naar de informatie vanuit hun eigen groep te luisteren. Dan komen ze in een soort echokamer terecht, waarin ze afgezonderd worden van belangrijke informatie. Je kan je afvragen of je dat wilt. Zeker als je het over iets belangrijks als vaccinatie hebt.”

Op de vraag of nepnieuws dan verboden zou moeten worden, laten beide professoren een veelzeggende lach ontsnappen

De aantasting van de autonomie kan nog concreter worden. Helberger weidt uit over het eerdergenoemde Cambridge Analytica, waarbij kiezers door onder meer nepnieuws gemanipuleerd werden tijdens de brexit- en Trump-campagnes. Kwalijk, zo meent Helberger: “Alle politieke partijen gebruiken Facebook voor politieke reclame, maar Facebook gebruikt reclame voor hele andere redenen. Zij zijn er niet om de democratie te bevorderen, maar om geld te verdienen. We moeten daarom goed nadenken over de commercialisering van de democratie.”

Op de vraag of nepnieuws dan verboden zou moeten worden, laten beide professoren een veelzeggende lach ontsnappen die verraadt dat het complexer is dan verbieden alleen. Smets bepleit dat zo’n verbod haaks staat op de vrijheid van meningsuiting. Het is pas problematisch wanneer nepnieuws bewust verspreid wordt met de bedoeling om mensen te manipuleren, maar dat is extreem moeilijk te controleren. “En het kan waanzinnige gevolgen hebben, zoals de aanslagen in Christchurch,” voegt Helberger toe. “Het gaat om een interactie tussen platformen, gebruikers, adverteerders, enzovoort.”

Dit is in grote lijnen de thematiek waar het onderzoeksprogramma Human(e) AI zich op gaat richten. De kennis die dat oplevert is één ding, maar dan rest de vraag wat er met die kennis gaat gebeuren. Ook daar zien Helberger en Smets een taak voor hen weggelegd. Een van de pilaren van het onderzoeksteam zal zijn om de maatschappij bewust te laten worden van de bovengenoemde thema’s.

Hoe dat precies gaat weten ze nog niet, maar Helberger oppert het idee om langs te gaan op scholen. Kinderen groeien op in een digitale realiteit, en dus is het nodig om ze hierover te informeren, luidt de gedachte. Daarnaast zullen ze zich ook gaan inspannen om beleidsmakers en maatschappelijke actoren te informeren en aan te sporen tot actie. Zo hopen ze ook een rol te kunnen spelen in wetgeving die zich met AI bezighoudt.

Antwoorden

Aangezien de onderzoeken zich vooral zullen richten op maatschappelijke en ethische vraagstukken, valt het nog te bezien of er eenduidige antwoorden te verwachten zijn. Maar we zijn inmiddels op een punt gekomen dat er simpelweg antwoorden nodig zijn, zegt Helberger: “We moeten een antwoord vinden. Er is geen keuze. Het punt is: wie moet die antwoorden formuleren? Wij kunnen opties, voordelen en nadelen laten zien, maar uiteindelijk is het een politiek-maatschappelijke beslissing. Wij kunnen informeren en uiteindelijk moet de maatschappij erover kunnen beslissen. Wij moeten eerst de argumenten vinden.”

Human(e) AI richt zich op grote problemen, maar zowel Smets als Helberger zijn optimistisch over de toekomst. Smets: “We maken een enorme revolutie mee. Zolang we op tijd de maatschappelijke effecten in kaart brengen, ben ik heel optimistisch.” Helberger is het daarmee eens. “De tijd tikt. We kunnen niet langer wachten. Maar ik ben ook een optimist. Technologie is zelf nooit goed of slecht, dus als we er bewust meegaan, kan het ons verder brengen.”